ChatGPTなどの「生成AI」が世界中で急速に普及しています。19日から行われるG7広島サミットで、日本は議長国として国際的なルールづくりを主導したいとしています。

生成AIとはそもそも何なのか?なぜルールが必要なのか?課題は?安藤隆キャスターが分かりやすく解説します。

そもそも生成AIとは?

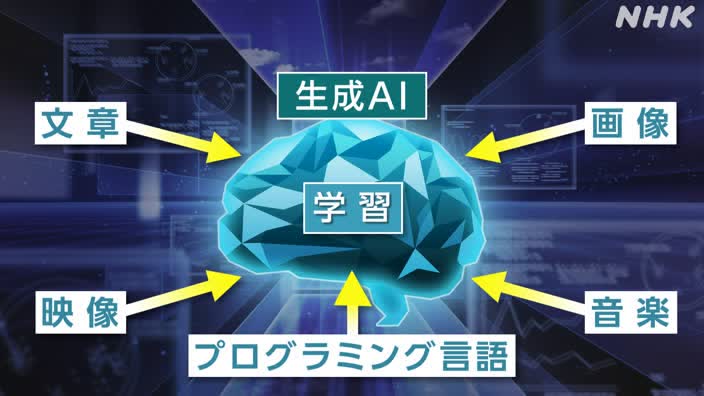

生成AIはインターネット上にある数千億とも言われる「文章」や「画像」、「音楽」や「映像」、「プログラミング言語」などを機械学習します。

利用者が質問をすると、求める条件に合った情報を自然な文章などの形で出力してくれて、私たちの暮らしや仕事、働き方を一変させるとも言われています。

大手コンサルティング会社によると、市場規模は2027年に世界で約16兆円と、22年からの5年間で13倍の規模に急成長するとの見通しもあります。

国際ルール追いつかず 企業は独自ルール模索

一方、開発や規制などを巡る国際的なルールの整備が追いつかないのが現状です。生成AIの活用に踏み切った企業では、独自のルールづくりの模索が始まっています。

大手生命保険会社「明治安田生命」は4月半ば、業務の効率化に役立てようと生成AIの実証実験を始めました。

この会社では、生成AIを扱う業務は情報収集や資料の作成などに限定し、顧客の個人情報や機密情報は入力しないと定めています。またAIが出した情報が正しいかどうか、人がチェックすることにしています。

担当者は、国際的なルールが追いつかない中でどうすれば安全に活用できるかを模索しています。

保険会社 デジタル戦略部 池田匡克さん

「全部を信頼はできない。出典が分からないというのがあるので、そこは慎重に取り扱う必要がある。リスクの対応についても、大きな枠組みがきちんと議論されるとわれわれは助かる。期待している」

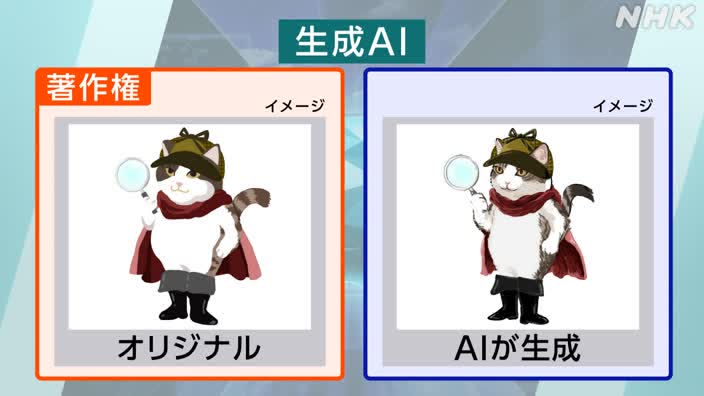

課題① 著作権の侵害

生成AIはさまざまな課題が指摘されていて、その一つが「著作権の侵害」です。例えば、猫のイラストを作成して誰かが著作権を持っている場合、このイラストを生成AIがネット上で学習すると、“作風が酷似したもの”が生み出される可能性があります。そのため法整備を求める声が上がっています。

課題②の1 ステルスマーケティング

また生成AIの可能性とリスクを研究する国立情報学研究所の佐藤一郎教授は「中立性」という大きな課題を指摘しています。

一つは、特定の企業の商品やサービスを偏って学習させることで、広告であることを隠したまま宣伝する「ステルスマーケティング」に使われるリスクです。

課題②の2 政府に有利なAI開発のリスク

もう一つ佐藤教授が指摘する中立性についての課題が、権威主義的な国が政府にとって有利な結果を出力できるように生成AIをつくることも可能だというリスクです。

国立情報学研究所 佐藤一郎教授

「中国はChatGPTに関しては禁止している。一方で、中国の大手IT企業のつくった対話型のAIに関しては、ある種の許認可制のような形をとって認めている。政府の意向に合わない対話型AI、生成AIを排除できることになるので、出力が政府に有利になることは当然考えておいたほうがいいと思う」

こうしたリスクを踏まえ、佐藤教授は、19日から始まるG7広島サミットで民主主義的な価値観を大事にしながらルールづくりで世界が足並みをそろえることが求められていると話します。

G7に温度差も

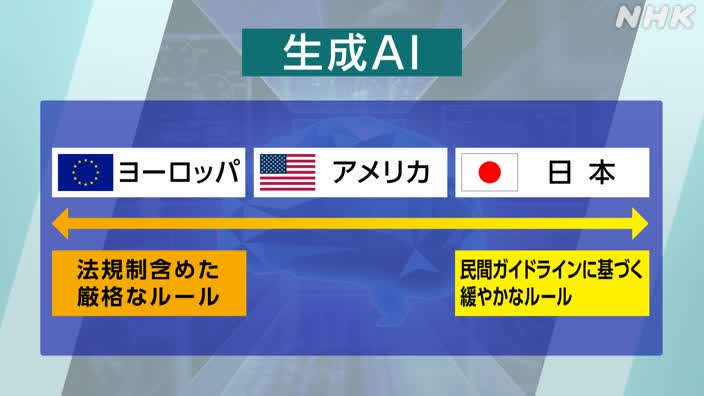

生成AIを巡るG7の足並みはどうなのか。具体的なルール、規制のあり方となると、法規制を含めたより厳格なルールを目指すヨーロッパと、民間ガイドラインに基づく緩やかなルールづくりを目指す日本などとの温度差があります。その温度差をどう埋めていこうとするのかが、G7の議論の焦点です。

【2023年5月17日放送】

あわせて読みたい