国内初の生成AI認証制度へ 若きスタートアップ経営者の挑戦

安全性などへの懸念が広がる生成AI。国内初の認証制度の開始に向けた準備が始まっている。

日本の大手企業など23社が主体となった動きを取りまとめたのは、27歳の若きスタートアップ経営者だった。

その“行動力”と“先見の明”の背景には何があったのか、インタビューで探った。

(経済部記者 名越大耕)

日本の大手企業など23社が主体となった動きを取りまとめたのは、27歳の若きスタートアップ経営者だった。

その“行動力”と“先見の明”の背景には何があったのか、インタビューで探った。

(経済部記者 名越大耕)

高校卒業後、渡米しハーバード大へ

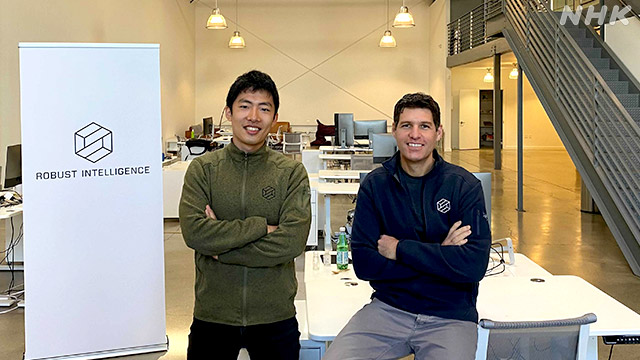

アメリカ・シリコンバレーに本社を置くスタートアップ企業「Robust Intelligence(ロバスト インテリジェンス)」。

創業者の大柴行人さんは1995年生まれの27歳だ。高校卒業後すぐに渡米し、ハーバード大学に進学した。

大学2年生の時、知人の起業を支援するため休学した際、AIの機械学習に関心を持ち、大学に戻ってからはAIのぜい弱性と保護システムの研究に打ち込んだ。

創業者の大柴行人さんは1995年生まれの27歳だ。高校卒業後すぐに渡米し、ハーバード大学に進学した。

大学2年生の時、知人の起業を支援するため休学した際、AIの機械学習に関心を持ち、大学に戻ってからはAIのぜい弱性と保護システムの研究に打ち込んだ。

研究を進めていくうちに、AIには情報漏えいなどといったセキュリティ面でのぜい弱性だけでなく、AI自体が差別することや、プライバシーを侵害していくといった別の意味のぜい弱性をはらんでいることに危機感を抱いたという。

大柴さん

「AIが社会に浸透していくことで、AIによって人の挙動が左右されるわけですよ。そうすると、AIのぜい弱性が人間社会のぜい弱性のリスクになっていってしまうんです。だからこそ、AIに何が正しく、何が問題の無い意思決定になるのか定義をしていかないといけないという課題意識を持つようになりました」

「AIが社会に浸透していくことで、AIによって人の挙動が左右されるわけですよ。そうすると、AIのぜい弱性が人間社会のぜい弱性のリスクになっていってしまうんです。だからこそ、AIに何が正しく、何が問題の無い意思決定になるのか定義をしていかないといけないという課題意識を持つようになりました」

AIのぜい弱性から人々を守る

大学卒業の直前に大柴さんは起業。AIのぜい弱性への対策を行うシステムを開発した。主に2つの事業を手がける。

一つ目は、企業が開発したAIのリスクを検出する技術。

例えば、生成AIを使ったチャットボットが差別的な回答をしないか、わずかに異なる質問に対して全く違う回答をしないかなどをチェックする。

このシステムを導入した企業は、数百のテストケースを用いてAIを検証し、製品のリリース前にリスクの軽減を図ることができる。リリース後も運用をしながらチェックを行えるシステムになっている。

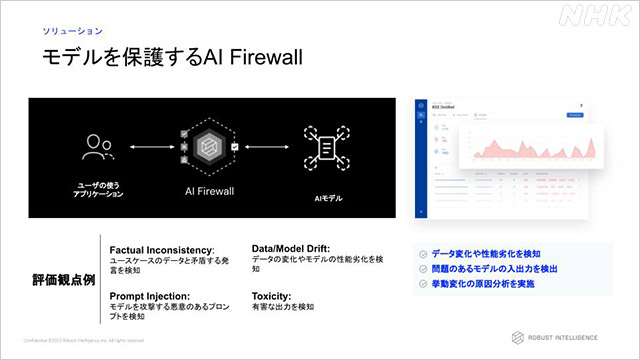

二つ目は、すでに市場に出ているAI製品を保護するAIファイアーウォール。

このプラットフォームは、ユーザーのアプリケーションとAIの間に設置され、有害な入力をブロックする。

また、AIが差別的な内容や倫理的に問題のある出力をしようとした場合も、ファイアーウォールでブロックできる。運用中のAIをリアルタイムで監視するシステムだ。

例えば、生成AIを使ったチャットボットが差別的な回答をしないか、わずかに異なる質問に対して全く違う回答をしないかなどをチェックする。

このシステムを導入した企業は、数百のテストケースを用いてAIを検証し、製品のリリース前にリスクの軽減を図ることができる。リリース後も運用をしながらチェックを行えるシステムになっている。

二つ目は、すでに市場に出ているAI製品を保護するAIファイアーウォール。

このプラットフォームは、ユーザーのアプリケーションとAIの間に設置され、有害な入力をブロックする。

また、AIが差別的な内容や倫理的に問題のある出力をしようとした場合も、ファイアーウォールでブロックできる。運用中のAIをリアルタイムで監視するシステムだ。

大柴さんの会社の顧客には、国防総省といったアメリカの政府機関をはじめ、大手金融機関などが名を連ねる。

日本でもAIを開発したり、活用したりする大手企業がこのシステムを導入しているという。

日本でもAIを開発したり、活用したりする大手企業がこのシステムを導入しているという。

大柴さん

「AIは元のデータによって挙動が変わっていくもので、ChatGPTのような生成AIは、1週間で勝手に挙動が変わっていきます。それって使う側からしたらたまったものじゃないですよね。今この瞬間、AIがしっかり動いているのか、継続的にテストしていかなければいけないのです」

「AIは元のデータによって挙動が変わっていくもので、ChatGPTのような生成AIは、1週間で勝手に挙動が変わっていきます。それって使う側からしたらたまったものじゃないですよね。今この瞬間、AIがしっかり動いているのか、継続的にテストしていかなければいけないのです」

AIに対する各国の考え方の違い

大柴さんは、ビジネスを通じて世界の各地域の間でAIに対する認識や立場に大きな違いがあると感じている。

EU=ヨーロッパ連合では、法律などで規制するいわゆる「ハードロー規制」の立場を取り、AI全般の活用を対象としたAI規制法の審議が続けられている。法律による規制を強めることで開発や利用を管理しようというスタイルだ。

一方、アメリカは、AIを重要な国内産業として位置づけていることから、企業が自主的な規制やガイドラインを作る「ソフトロー路線」を取っている。

厳格な規制ありきの方法ではなく、企業が主体となって活用を拡大しようというアプローチになる。

こうした中、日本は、アメリカとEUの中間的な立場を取っていて、“人間中心主義”に基づき、極端な規制を避けつつも、バランスの取れた制度設計を目指しているという。

厳格な規制ありきの方法ではなく、企業が主体となって活用を拡大しようというアプローチになる。

こうした中、日本は、アメリカとEUの中間的な立場を取っていて、“人間中心主義”に基づき、極端な規制を避けつつも、バランスの取れた制度設計を目指しているという。

大柴さん

「日本人のDNAの中にドラえもんの世界観があり、AIとか機械との共存というのが染みついていると思う。統制の取りやすさは日本にアドバンテージがあると思う。日本って、品質とかリスクに対してどのように扱うのか考え抜く国だと思うんですよ。グローバルスタンダードを取れるのではないかと思っています」

「日本人のDNAの中にドラえもんの世界観があり、AIとか機械との共存というのが染みついていると思う。統制の取りやすさは日本にアドバンテージがあると思う。日本って、品質とかリスクに対してどのように扱うのか考え抜く国だと思うんですよ。グローバルスタンダードを取れるのではないかと思っています」

国内初の認証制度へ

日本ではことし10月、国内初となる生成AIの認証制度を作ろうと、新たな業界団体「AIガバナンス協会」が設立された。

大柴さんがいわば発起人となり、国内で生成AIを開発するNECやNTTデータ、それに生成AIを活用する大手メガバンクなど23社が参加している。来年4月には一般社団法人化し、認証制度をスタートさせる計画だ。

こうした認証制度の設立は、アメリカでも議論が始まっていて、生成AIに対する規制を求める声も高まるなかで、企業が主体となって動き出すことで生成AIの活用を加速させるねらいがある。

こうした認証制度の設立は、アメリカでも議論が始まっていて、生成AIに対する規制を求める声も高まるなかで、企業が主体となって動き出すことで生成AIの活用を加速させるねらいがある。

大柴さん

「AIの技術者はリスクやコンプライアンスの専門家ではなく、それらを決めるべきではないんです。一方で、リスク管理の責任ある人たちは、AIを最近知った人たちが多いんです。そのため、1つの企業の中で、技術者とリスク責任者の間に大きな溝があると思うんですよね。この溝を埋めてあげないと、AIがリスクが大きいままどんどん活用される。もしくは、リスクがボトルネックになってAIが怖いから導入が進まないという機会損失があり得るんです。だから僕らは、AIが安全でセキュアで公平で、こうあるべきというのを経営やリスク管理側に伝えて、反映させていく必要があるんです」

「AIの技術者はリスクやコンプライアンスの専門家ではなく、それらを決めるべきではないんです。一方で、リスク管理の責任ある人たちは、AIを最近知った人たちが多いんです。そのため、1つの企業の中で、技術者とリスク責任者の間に大きな溝があると思うんですよね。この溝を埋めてあげないと、AIがリスクが大きいままどんどん活用される。もしくは、リスクがボトルネックになってAIが怖いから導入が進まないという機会損失があり得るんです。だから僕らは、AIが安全でセキュアで公平で、こうあるべきというのを経営やリスク管理側に伝えて、反映させていく必要があるんです」

日本の役割は大きい

大柴さんがアメリカに拠点があるにもかかわらず、日本で認証制度を作ろうとしたのは、世界のスタンダードになるポテンシャルがあると考えたからだ。

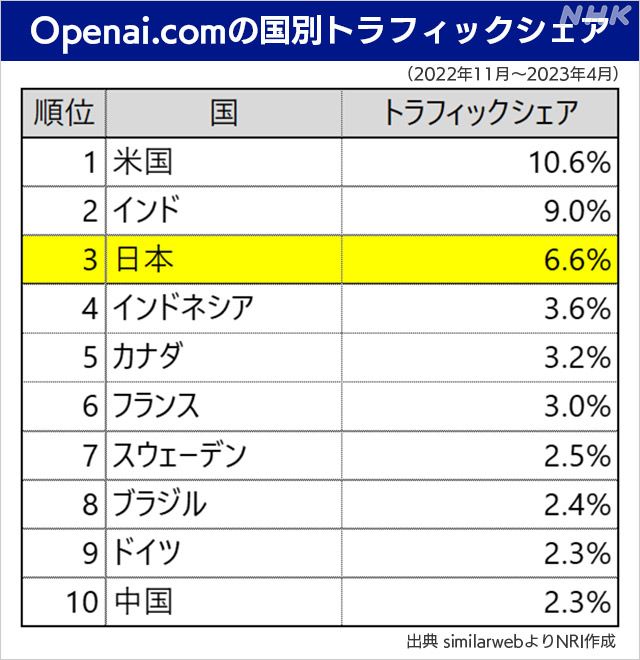

野村総合研究所がまとめた調査では、ChatGPTなどを提供するオープンAIのウェブサイトへのアクセス量の国別の割合は、1位のアメリカや2位のインドに次いで、日本は3位となっている。

野村総合研究所がまとめた調査では、ChatGPTなどを提供するオープンAIのウェブサイトへのアクセス量の国別の割合は、1位のアメリカや2位のインドに次いで、日本は3位となっている。

人口比でみると、アメリカやインドよりも実は日本がChatGPTの利用度合いが高いということになる。

AIの開発自体は、すでに遅れをとっている日本だが、その利用率の高さでは世界の中でも存在感を示している。

現状の日本の基礎研究のレベルでは、他国のようなAIの開発はすぐには難しい一方で、品質やリスクに対する意識の高い日本は、AIと社会をどう融合させるのかという複合領域で世界への勝ち筋があると大柴さんは考える。

AIの開発自体は、すでに遅れをとっている日本だが、その利用率の高さでは世界の中でも存在感を示している。

現状の日本の基礎研究のレベルでは、他国のようなAIの開発はすぐには難しい一方で、品質やリスクに対する意識の高い日本は、AIと社会をどう融合させるのかという複合領域で世界への勝ち筋があると大柴さんは考える。

大柴さん

「いつから日本は世界に見本を見せる側ではなくて、見せてもらう側になってしまったんだと。それに、AIの業界ってスタートアップのイノベーションが入ってくる。この認証があれば、会社の資本金とか、従業員の数がどれくらいかとなどの体裁的なものではなく、認証が、AIをしっかりつくっていることの証になる。認証を中心に日本のAIのエコシステムを発展させれば、自分たちのようなスタートアップでもAIのアプリケーションを提供しやすくなるし、日本のAIの技術全体を支えることができる」

「いつから日本は世界に見本を見せる側ではなくて、見せてもらう側になってしまったんだと。それに、AIの業界ってスタートアップのイノベーションが入ってくる。この認証があれば、会社の資本金とか、従業員の数がどれくらいかとなどの体裁的なものではなく、認証が、AIをしっかりつくっていることの証になる。認証を中心に日本のAIのエコシステムを発展させれば、自分たちのようなスタートアップでもAIのアプリケーションを提供しやすくなるし、日本のAIの技術全体を支えることができる」

取材後記

生成AIの開発で日本は、アメリカ企業に大きく差をつけられているのが実態だ。

ただ今回の取材を通して感じたのは、今後重要になるのは開発だけでなく、どのようにして社会に実装させていくかということであり、日本が抱える少子高齢化や労働力不足に対し、生成AIの活用を進めていく実績を重ねることがチャンスになる。

国内初の認証制度を通じて、ぜい弱性などのリスクに対応しながら社会実装につなげ、その知見を世界に広げることが期待される。

ただ今回の取材を通して感じたのは、今後重要になるのは開発だけでなく、どのようにして社会に実装させていくかということであり、日本が抱える少子高齢化や労働力不足に対し、生成AIの活用を進めていく実績を重ねることがチャンスになる。

国内初の認証制度を通じて、ぜい弱性などのリスクに対応しながら社会実装につなげ、その知見を世界に広げることが期待される。

経済部記者

名越大耕

2017年入局

福岡局を経て現所属

AI、情報通信や電機業界を担当

名越大耕

2017年入局

福岡局を経て現所属

AI、情報通信や電機業界を担当