AIリスクにどう向き合う?

最近、聞かない日がないほど報道されている「ChatGPT」。

日本でも急速に広まっているので、すでに使っている方も多いかも知れません。

ただ、気軽に使える一方で、プライバシーの侵害などリスクも指摘されています。

世界の主要7か国の閣僚が集まって日本で開かれた国際会議でも“想定外のスピード”で進化するAIにどう対応するか、急きょ議論が交わされました。

(経済部記者 谷川浩太朗、名越大耕/ロサンゼルス支局記者 山田奈々)

日本でも急速に広まっているので、すでに使っている方も多いかも知れません。

ただ、気軽に使える一方で、プライバシーの侵害などリスクも指摘されています。

世界の主要7か国の閣僚が集まって日本で開かれた国際会議でも“想定外のスピード”で進化するAIにどう対応するか、急きょ議論が交わされました。

(経済部記者 谷川浩太朗、名越大耕/ロサンゼルス支局記者 山田奈々)

ChatGPTの衝撃

2022年11月にアメリカのオープンAI社が公開した対話式AIのChatGPT。

質問を打ち込むと、あたかも人間のような自然な文章で回答してくれることからたちまち世界で利用が広がりました。

質問に答えるだけでなく、長い文章を要約したり、コンピューターのプログラミングコードを作ったりと、AIの専門的な知識がない人でも簡単に使えます。

ChatGPTのように利用者の求めに応じて、文章や画像などを自動で作り出すことができるAIは「生成AI」といいます。

どうしてこんなことができるかと言えば、インターネット上にある大量のデータを学習し、人間好みの文章が回答されるよう微調整されているからです。

質問に答えるだけでなく、長い文章を要約したり、コンピューターのプログラミングコードを作ったりと、AIの専門的な知識がない人でも簡単に使えます。

ChatGPTのように利用者の求めに応じて、文章や画像などを自動で作り出すことができるAIは「生成AI」といいます。

どうしてこんなことができるかと言えば、インターネット上にある大量のデータを学習し、人間好みの文章が回答されるよう微調整されているからです。

国内でも利用拡大

業務の効率化につながることを期待して、いま国内でも利用する企業が相次いでいます。

大手化学メーカーの三井化学は、ことし4月から「ChatGPT」を活用する実証実験を始めました。

大手化学メーカーの三井化学は、ことし4月から「ChatGPT」を活用する実証実験を始めました。

この会社では商品化につながる化学素材の新しい用途を見つけるため、これまでは別の会社のAIを使って、膨大なデータから手がかりを探していましたが、ことばの抽出に強みがある「ChatGPT」を新たに組み合わせました。

その結果、これまでは最大で3か月程度かかっていた結果が出るまでの期間が飛躍的に短くなりました。

その結果、これまでは最大で3か月程度かかっていた結果が出るまでの期間が飛躍的に短くなりました。

三井化学 三瓶雅夫常務

「私どもはデジタル化が遅れた会社だと思っている。AIについて何もしないでいるとこの差が全然縮まらない。我々がやっていくべきことは、この新しいテクノロジーをまず使ってみてトライする。そして、そのつど修正していくことが必要だと思う」

「私どもはデジタル化が遅れた会社だと思っている。AIについて何もしないでいるとこの差が全然縮まらない。我々がやっていくべきことは、この新しいテクノロジーをまず使ってみてトライする。そして、そのつど修正していくことが必要だと思う」

生成AI市場 2027年に16兆円予測も

大手コンサルティング会社のボストンコンサルティンググループによりますと、生成AIの市場規模は2027年には世界で1210億ドル、日本円でおよそ16兆円に達するとみられています。

2022年の90億ドルと比べると約13倍、市場の急拡大が見込まれています。

小売業界のマーケティングや製薬会社の医薬品の研究開発、銀行の融資判断など、さまざまな業界で利用が広がり、これまでの仕事のしかたが一変する可能性もあります。

2022年の90億ドルと比べると約13倍、市場の急拡大が見込まれています。

小売業界のマーケティングや製薬会社の医薬品の研究開発、銀行の融資判断など、さまざまな業界で利用が広がり、これまでの仕事のしかたが一変する可能性もあります。

利便性の一方、懸念も…

しかし、利用の拡大にともなって、プライバシーや著作権の侵害、誤った情報の拡散などさまざまな懸念も指摘されるようになっています。

例えば、十分に学習できていない分野でも、AIが誤った内容や存在しない事実をあたかも事実かのように回答してしまうケースがあります。

技術の悪用も大きな課題で、SF雑誌を手がけるアメリカの出版社ではAIが書いたとみられる作品の応募が急増しました。

例えば、十分に学習できていない分野でも、AIが誤った内容や存在しない事実をあたかも事実かのように回答してしまうケースがあります。

技術の悪用も大きな課題で、SF雑誌を手がけるアメリカの出版社ではAIが書いたとみられる作品の応募が急増しました。

ことし2月には500件以上になり、作品の募集を一時、中止せざるを得なくなりました。

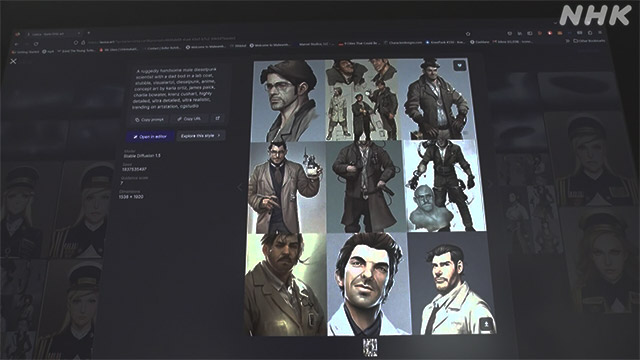

許可なく自分の作品をAIに学習されたとして、アメリカではアーティストが集団訴訟を起こす動きも出ています。

許可なく自分の作品をAIに学習されたとして、アメリカではアーティストが集団訴訟を起こす動きも出ています。

日本でも「画像生成AI」の不適切な使用で、クリエーターの創作活動や権利が脅かされているなどとして、イラストレーターや漫画家などで作る団体が、適切な使用や法整備などを求める提言を発表しています。

また、AIが個人情報や企業などの機密情報を含んだデータを学習してしまった場合にプライバシーの侵害や情報漏えいなどの懸念も指摘されています。

また、AIが個人情報や企業などの機密情報を含んだデータを学習してしまった場合にプライバシーの侵害や情報漏えいなどの懸念も指摘されています。

G7で急きょ議論

AIに対するさまざまな懸念が広がる中で、各国の政府も対応を迫られています。

とくにChatGPTの登場で、こうした懸念にどう対処するかが課題となっているにもかかわらず、AIの急速な進化や利用の拡大にルール作りが追いついていないのです。

このため、先月29日と30日に開かれたG7デジタル・技術相会合でもChatGPTなどの生成AIが急きょ、議論されることになったのです。

とくにChatGPTの登場で、こうした懸念にどう対処するかが課題となっているにもかかわらず、AIの急速な進化や利用の拡大にルール作りが追いついていないのです。

このため、先月29日と30日に開かれたG7デジタル・技術相会合でもChatGPTなどの生成AIが急きょ、議論されることになったのです。

日本の交渉関係者によりますと、生成AIが重要な議論のテーマとして浮上したのは、会合を前にしたことし2月末になってからだといいます。

議長国の日本は「信頼できるAI」を掲げて、プライバシーや著作権保護とAIの技術開発や活用を両立させるためのルール作りの議論にのぞむことになりました。

議長国の日本は「信頼できるAI」を掲げて、プライバシーや著作権保護とAIの技術開発や活用を両立させるためのルール作りの議論にのぞむことになりました。

各国で異なるルールへの姿勢

プライバシーの侵害や情報流出などの懸念も広がる中、会合に臨むG7の国々でも何らかのルールは必要だという認識では一致しています。

しかし、具体的な規制のあり方については立場の違いがあります。

プライバシーの保護など個人の権利を重視するヨーロッパの国々は、法規制を含めた厳格なルール作りを目指しています。

例えば、EU=ヨーロッパ連合の執行機関、ヨーロッパ委員会は2021年、AIの規制法案を議会や加盟国に提出し、法律の成立に向けて現在も議論が続いています。

しかし、具体的な規制のあり方については立場の違いがあります。

プライバシーの保護など個人の権利を重視するヨーロッパの国々は、法規制を含めた厳格なルール作りを目指しています。

例えば、EU=ヨーロッパ連合の執行機関、ヨーロッパ委員会は2021年、AIの規制法案を議会や加盟国に提出し、法律の成立に向けて現在も議論が続いています。

この法案ではAIをリスクに応じて4つのグループに分類し、もっともリスクの高い「許容できないリスク」のAIは基本的な人権を侵害するとして利用が禁止されます。

ここにきて、AIの自由な開発を推進してきたアメリカでも、規制案を検討する動きも出ています。

アメリカ商務省は規制案に向けてAIの評価や認証制度などについて一般からの意見募集を開始しています。

著作権を侵害されたとして集団訴訟も起きるなど、AIに対する警戒感も出ています。

こうした中でも、活用に前のめりなのが日本です。

企業による研究開発や利用の推進を重視していて、民間のガイドラインに基づく緩やかなルール作りを目指しています。

海外勢がAIの開発で先行する中、法的な規制はAIの開発や利用を遅らせかねないとして慎重な立場です。

初日の会合でも西村経済産業大臣はAIなどの技術について、「破壊的な影響を持つ技術は社会を大きく変革するため、リスクを迅速に評価し対応する必要がある。しかし、リスクの解消にあたってはできるかぎり技術の開発や利活用を阻害しない形で対応する必要がある」と述べました。

ここにきて、AIの自由な開発を推進してきたアメリカでも、規制案を検討する動きも出ています。

アメリカ商務省は規制案に向けてAIの評価や認証制度などについて一般からの意見募集を開始しています。

著作権を侵害されたとして集団訴訟も起きるなど、AIに対する警戒感も出ています。

こうした中でも、活用に前のめりなのが日本です。

企業による研究開発や利用の推進を重視していて、民間のガイドラインに基づく緩やかなルール作りを目指しています。

海外勢がAIの開発で先行する中、法的な規制はAIの開発や利用を遅らせかねないとして慎重な立場です。

初日の会合でも西村経済産業大臣はAIなどの技術について、「破壊的な影響を持つ技術は社会を大きく変革するため、リスクを迅速に評価し対応する必要がある。しかし、リスクの解消にあたってはできるかぎり技術の開発や利活用を阻害しない形で対応する必要がある」と述べました。

G7会合 合意できたのは…

こうした中で、とりまとめられたG7の閣僚声明では、プライバシーの侵害や情報漏えいといったリスクのない「信頼できるAI」の普及を目指すという大枠では一致しました。

そのための取り組みとして、国際的な技術の標準化を進めることや、国際機関でAIの影響や課題を分析することなどを盛り込んだ行動計画が採択されました。

また、法の支配や人権の尊重など民主主義的な価値観に基づいてAIやデータを活用していく姿勢を強調し、各論では立場が異なることを認めつつも、総論としてG7の結束を打ち出す形となりました。

そのための取り組みとして、国際的な技術の標準化を進めることや、国際機関でAIの影響や課題を分析することなどを盛り込んだ行動計画が採択されました。

また、法の支配や人権の尊重など民主主義的な価値観に基づいてAIやデータを活用していく姿勢を強調し、各論では立場が異なることを認めつつも、総論としてG7の結束を打ち出す形となりました。

結束を強調した背景にあるのが中国などの存在です。

AIに関する議論をまとめた声明文では、中国などを念頭に「われわれは民主主義の価値を損ない表現の自由を抑圧し、人権の享受を脅かすようなAIの誤用・乱用に反対する」と明記しました。

市民の監視や偽情報の拡散などにAIを悪用されないようけん制した形です。

さらに知的財産権の保護や透明性の確保、偽情報対策などが必要だとして、ことし後半にG7として改めて議論の場を設けることも決まりました。

AIに関する議論をまとめた声明文では、中国などを念頭に「われわれは民主主義の価値を損ない表現の自由を抑圧し、人権の享受を脅かすようなAIの誤用・乱用に反対する」と明記しました。

市民の監視や偽情報の拡散などにAIを悪用されないようけん制した形です。

さらに知的財産権の保護や透明性の確保、偽情報対策などが必要だとして、ことし後半にG7として改めて議論の場を設けることも決まりました。

具体的なルール作りへの道筋は?

今回、各国の立場の隔たりを認めたうえで、結束を演出したとも言えるG7。

しかし、活用と規制の最適なバランスに向けて、どうやって具体的なルール作りを進めていくかは引き続き課題として残っています。

「破壊的な影響を持つ技術は社会を大きく変革する」という西村経済産業大臣のことばの通り、ChatGPTをはじめとする生成AIの進化は、私たちの暮らしはもちろん、社会までもいい方向にも悪い方向にも変える可能性があります。

最先端のAIのリスクを避けながら、そのメリットをどう生かしていくか。

私たちは難しい課題に直面しています。

しかし、活用と規制の最適なバランスに向けて、どうやって具体的なルール作りを進めていくかは引き続き課題として残っています。

「破壊的な影響を持つ技術は社会を大きく変革する」という西村経済産業大臣のことばの通り、ChatGPTをはじめとする生成AIの進化は、私たちの暮らしはもちろん、社会までもいい方向にも悪い方向にも変える可能性があります。

最先端のAIのリスクを避けながら、そのメリットをどう生かしていくか。

私たちは難しい課題に直面しています。

経済部記者

谷川浩太朗

2013年入局

沖縄局、大阪局を経て現所属

総務省と情報通信業界などを担当

谷川浩太朗

2013年入局

沖縄局、大阪局を経て現所属

総務省と情報通信業界などを担当

経済部記者

名越大耕

2017年入局

福岡局を経て現所属

デジタル庁と情報通信業界などを担当

名越大耕

2017年入局

福岡局を経て現所属

デジタル庁と情報通信業界などを担当

ロサンゼルス支局記者

山田奈々

2009年入局

長崎局、経済部、国際部などを経て現所属

山田奈々

2009年入局

長崎局、経済部、国際部などを経て現所属