「AI兵器」の衝撃 “機械は犠牲を理解できず”暗い未来の不安

冷戦のさなか、旧ソビエト軍の1人の中佐の判断が核戦争の勃発を防いだとされる出来事があった。アメリカ軍の核ミサイル攻撃を探知した監視システムの情報を、状況から誤作動と判断、ソビエト側の報復攻撃を防いだ。

しかし今、各国でAI=人工知能を使って、より自律性を高めた「AI兵器」の開発競争が激化している。

すでに戦地では20秒以内に攻撃の判断を求められるAIシステムの使用が伝えられている。

人間の判断が介在しない究極のAI兵器が登場したら、この世界はどうなるのだろうか。

(国際部記者 山下涼太)

しかし今、各国でAI=人工知能を使って、より自律性を高めた「AI兵器」の開発競争が激化している。

すでに戦地では20秒以内に攻撃の判断を求められるAIシステムの使用が伝えられている。

人間の判断が介在しない究極のAI兵器が登場したら、この世界はどうなるのだろうか。

(国際部記者 山下涼太)

AI兵器が投入されるウクライナ戦線

「AI兵器」はすでに戦場で次々と投入され、兵士に代わってより高度な作戦を行う世界が現実のものとなりつつある。

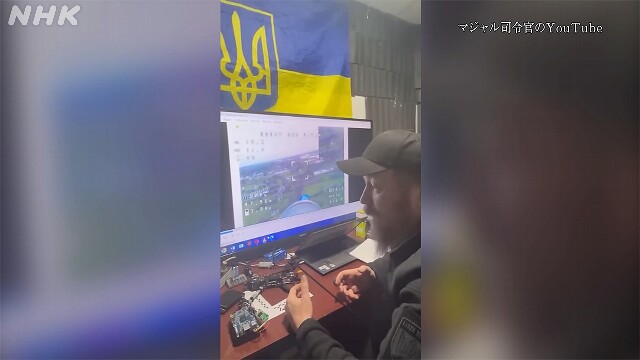

2022年2月に始まったロシアによる軍事侵攻に対抗するウクライナ。物量で上回る大国との消耗戦になる中、遠隔操作型の無人機で偵察や監視・攻撃までを行い、善戦につなげてきた。

しかし、このところロシア側の電波妨害により、無人機の通信が途絶えて制御を失うケースが増え、無人機の損耗が増加。

このため、ウクライナ軍はAIを搭載した無人機を戦地に投入し始めている。遠隔操作やGPSを必要としないため、電波妨害の影響を受けずに自律飛行ができる。

ウクライナ側の2023年10月の発表によれば、こうしたAIを搭載し、自動で目標の検知と追跡を行う無人機をすでに2000機、配備しているという。

しかし、このところロシア側の電波妨害により、無人機の通信が途絶えて制御を失うケースが増え、無人機の損耗が増加。

このため、ウクライナ軍はAIを搭載した無人機を戦地に投入し始めている。遠隔操作やGPSを必要としないため、電波妨害の影響を受けずに自律飛行ができる。

ウクライナ側の2023年10月の発表によれば、こうしたAIを搭載し、自動で目標の検知と追跡を行う無人機をすでに2000機、配備しているという。

アメリカのCNNテレビは、国境から1000キロ離れたロシア国内の石油施設が狙われたことし3月の無人機攻撃について、「AI搭載の無人機を使った」とするウクライナ当局者の話を伝えている。

ことし4月中旬、NHKの取材に応じたボルニャコフ・デジタル変革担当次官は、すでに自律した無人機で自爆攻撃も行っていると明らかにし、その狙いをこう語った。

ボルニャコフ次官

「ロシアの軍事力は巨大で資源も人員も戦車などの装備もかなわない。技術で我々は彼らに対抗しようとしている。ウクライナは間違いなくAIの『兵器化』の最前線といえる」

「ロシアの軍事力は巨大で資源も人員も戦車などの装備もかなわない。技術で我々は彼らに対抗しようとしている。ウクライナは間違いなくAIの『兵器化』の最前線といえる」

AI兵器の開発競争、その先にあるものは?

もともとITが盛んな国として知られるウクライナ。ボルニャコフ次官によると、侵攻が始まった当時、AIを軍事利用するノウハウはほぼないに等しかったが、いまではAIの軍事利用に関わる開発は200を超えているという。

さらに今、ウクライナが目指すのが、1人のオペレーターが複数の無人機を操って攻撃を行う、より自律性の高い「無人機のスウォーム(群れ)」だという。早ければ今年にも、無人機のスウォームの投入を目指している。

さらに今、ウクライナが目指すのが、1人のオペレーターが複数の無人機を操って攻撃を行う、より自律性の高い「無人機のスウォーム(群れ)」だという。早ければ今年にも、無人機のスウォームの投入を目指している。

一方で、ロシア側でもAIを搭載した無人機の投入が確認されている。ウクライナ軍の無人機部隊の司令官は、ロシア軍の無人機からAIが見つかったとする動画を投稿している。

戦地で相次ぐAI兵器の投入。今後、この開発競争はどこまで突き進むことになるのか。

ボルニャコフ・デジタル変革担当次官に問うと、少し考えたあと、こう言い切った。

戦地で相次ぐAI兵器の投入。今後、この開発競争はどこまで突き進むことになるのか。

ボルニャコフ・デジタル変革担当次官に問うと、少し考えたあと、こう言い切った。

「技術革新は私たちが生き残る手段だ。ロシアはちゅうちょなく、より殺傷能力の高い兵器の開発に日々取り組んでいる。この開発競争は終わりがない。総力戦に向かうことが人類にとって正しい道だとも思っていない。ただ私たちはこの道を進まなければならない。さもなければロシアが有利になってしまう」

犠牲とまらぬガザ 告発の衝撃

AIの軍事利用をいち早く進めてきたのが中東のイスラエル。

3万人を超える犠牲が出ているガザ地区への作戦では、AIを使った兵器やシステムを導入しているとイスラエル軍も発表している。

3万人を超える犠牲が出ているガザ地区への作戦では、AIを使った兵器やシステムを導入しているとイスラエル軍も発表している。

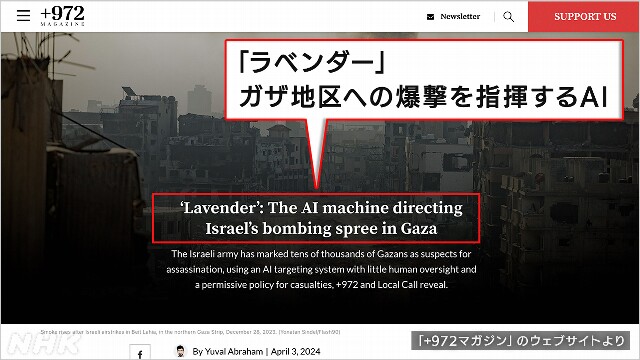

そうした中、ことし4月、イスラエルメディア「+972マガジン」が発表した調査報道が世界に衝撃を与えた。イスラエル軍のAIが、多数の民間人の犠牲を生み出す背景にあるのではという疑いを、軍関係者らの証言をもとに報じたのだ。

それは「ラベンダー」と呼ばれるAIによるデータベース。イスラム組織ハマスの戦闘員と疑われる人物を割り出し、攻撃目標を設定するために使われているという。

「ラベンダー」にはガザ地区の住民、230万人のさまざまな情報が集められていて、ハマスなどの戦闘員と疑われる人物を評価。

それは「ラベンダー」と呼ばれるAIによるデータベース。イスラム組織ハマスの戦闘員と疑われる人物を割り出し、攻撃目標を設定するために使われているという。

「ラベンダー」にはガザ地区の住民、230万人のさまざまな情報が集められていて、ハマスなどの戦闘員と疑われる人物を評価。

その可能性を1から100までの数値で示すという。ハマスの戦闘員の特徴とされる要素に複数、当てはまる場合は空爆などを行う際の攻撃目標となる。その人数は、ピーク時で3万7000人にも上ったと報じられた。

“巻き添えも許可 攻撃承認までわずか20秒!?”

今回の報復作戦でも、とりわけ初期に使用されたとされる「ラベンダー」。

イスラエル側は強く否定しているものの、「+972マガジン」と「ローカルコール」の報道によると、イスラエル軍は「ラベンダー」で割り出したハマスの戦闘員を攻撃する際、これまでのガザ地区での作戦では認めることがなかった15人から20人の民間人の巻き添えを容認。ハマスの高官を標的とする場合は、「100人以上」が巻き添えとなることも許可していると伝えられている。

イスラエル側は強く否定しているものの、「+972マガジン」と「ローカルコール」の報道によると、イスラエル軍は「ラベンダー」で割り出したハマスの戦闘員を攻撃する際、これまでのガザ地区での作戦では認めることがなかった15人から20人の民間人の巻き添えを容認。ハマスの高官を標的とする場合は、「100人以上」が巻き添えとなることも許可していると伝えられている。

さらに報道によって「ラベンダー」のAIが、人間の処理能力を上回る形で、攻撃目標を示していたという懸念も浮かび上がっている。

ハマスの戦闘員として疑われた人物が実際に組織に所属している精度は90%程度。その状況下で、「ラベンダー」のオペレーターたちは、攻撃目標が示されてから攻撃を承認するまで、わずか20秒ほどの時間しか与えられなかったという。報道では、こうした関係者たちの驚くべき証言を伝えている。

「ターゲットが男性であることだけを確認した」

「ハマスの戦闘員が関係のない家族や知人などに携帯電話を渡した場合、その人は家族と一緒に爆撃された。ラベンダーが引き起こしたミスだ」

ハマスの戦闘員として疑われた人物が実際に組織に所属している精度は90%程度。その状況下で、「ラベンダー」のオペレーターたちは、攻撃目標が示されてから攻撃を承認するまで、わずか20秒ほどの時間しか与えられなかったという。報道では、こうした関係者たちの驚くべき証言を伝えている。

「ターゲットが男性であることだけを確認した」

「ハマスの戦闘員が関係のない家族や知人などに携帯電話を渡した場合、その人は家族と一緒に爆撃された。ラベンダーが引き起こしたミスだ」

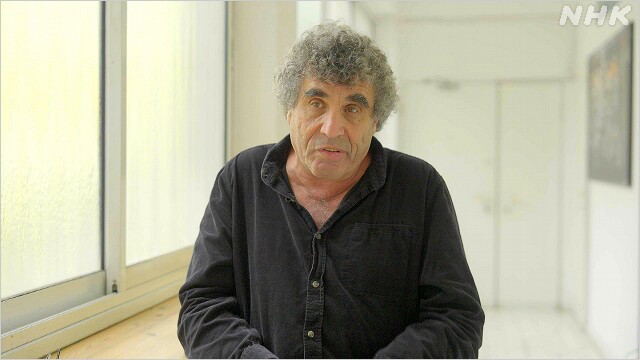

この調査報道を伝えた「+972マガジン」と「ローカルコール」の編集者、メロン・ラポポルト氏に話を聞いた。

メロン・ラポポルト氏

「ガザ地区ではAIを使った兵器による大規模な殺りくが起きている。多くの軍関係者が口にしたのは標的の承認がほぼ自動的に行われたということだ。私たちが暮らす社会で兵士が人命に対してこれほど無関心であり、残酷であることに強い悲しみを覚えました。AIはボタンを押すことで、人を殺害するという重い責任を伴う判断を下す人間とその結果を切り離してしまった点で、戦場を変えてしまった」

「ガザ地区ではAIを使った兵器による大規模な殺りくが起きている。多くの軍関係者が口にしたのは標的の承認がほぼ自動的に行われたということだ。私たちが暮らす社会で兵士が人命に対してこれほど無関心であり、残酷であることに強い悲しみを覚えました。AIはボタンを押すことで、人を殺害するという重い責任を伴う判断を下す人間とその結果を切り離してしまった点で、戦場を変えてしまった」

これに対して、イスラエル軍は「ラベンダー」の存在は認める一方で、「情報システムはあくまでも標的を特定するプロセスのなかで使用するツールにすぎない。戦闘員の特定や戦闘員かどうかの予測にAIシステムは使用していない」とその内容を強く否定している。

米ロ中で激化するAI兵器の開発競争

一方で、兵士の犠牲や負担を減らすことができるなどの利点から、軍事分野でのAIの開発競争は、軍事大国を中心にいっそう加速している。

ロシアでは、プーチン大統領が2023年に「AIこそが未来だ。ロシアやどの国にとっても重要なことで、1940年代半ばから1950年代にかけての旧ソ連の原子爆弾やミサイルのプロジェクトと同じレベルだ」と述べた、と伝えられている。

中国は習近平国家主席がことし3月、中国軍などとの会議でAIの軍事利用を強化していくと強調。詳しい開発の実態はほとんど公表されていないものの、アメリカ国防総省などは、中国がAIによって自律性を高めた無人機や無人艇の開発に加え、偵察・監視能力などにもAIの利用を進めていると指摘している。

そして、アメリカでは国防総省が数千の自律型システムを配備する計画を発表。この計画では、2025年までにインド太平洋地域に無人機や無人艇が配備される見通しだ。

相次ぐ新興企業の参入“未来の戦場の姿”

AIの軍事利用は民間企業も巻き込んだ軍民一体の形でさらに加速していくとみられている。

ことし4月上旬、アメリカ東部・メリーランド州で開かれたアメリカ軍主催の軍事見本市。

ことし4月上旬、アメリカ東部・メリーランド州で開かれたアメリカ軍主催の軍事見本市。

会場には、大手の軍事会社に加えて、軍事AIの市場拡大に目をつけた新興企業が参加していた。戦闘機とともに自律して飛行し任務支援を行う無人機や、1人で操作できる新型の無人迎撃システムなど、AIを利用した最新の製品の映像などが多く展示された。革新的な技術を駆使した数々の兵器は「未来の戦場の姿」を予感させるものだった。

設立7年という軍事AIのスタートアップ企業に話を聞くと、「構想からわずか2年で開発からアメリカ軍の審査通過までこぎつけた。驚異的な速度だ。AIなどのソフトウェアは今、軍隊の要求にあわせて、いかようにも開発されている」と語り、AIが可能にする技術進展のスピードに胸を張った。

会場では、アメリカ軍関係者や企業が登壇して「AI戦闘空間の未来」と題するセッションも開かれていた。利用に慎重さを求める声は一部であったものの、開発をさらに加速するべきという意見が相次いだ。

海兵隊 コリン・クロスビー データサービス・オフィサー

「私たち海兵隊はより賢く戦いたいのです。戦場にいる指揮官の意思決定の支援、データの取得、そしてリアルタイムの情報に対応することが重要になります」

「私たち海兵隊はより賢く戦いたいのです。戦場にいる指揮官の意思決定の支援、データの取得、そしてリアルタイムの情報に対応することが重要になります」

軍事AI企業「シールドAI」ブランドン・ツェン社長

「すべての兵器はAIによって指揮され、操縦されるべきです。非常に小さなチームで、多くの部隊の攻撃を指揮することが近い将来、実現するでしょう」

「すべての兵器はAIによって指揮され、操縦されるべきです。非常に小さなチームで、多くの部隊の攻撃を指揮することが近い将来、実現するでしょう」

セッションのあと、登壇していた企業の社長を直撃した。名前はブランドン・ツェン。アメリカ海軍特殊部隊「シールズ」の出身で、アフガニスタンにも派遣された経験から軍事AI企業を立ち上げたという。

ツェン氏の企業はパイロットの養成に何年間も要する戦闘機を、自動操縦できるAIを開発したことで知られている。ツェン氏はそうした技術によって「プロセスに人間の関与がいらなくなっている。それはすでに実用化されている」と自信たっぷりに語った。

ブランドン・ツェン社長

「AIは今世紀の重要な抑止力の一つだ。もし私たちがAIでリードしていなければ、敵対する国、ロシアや中国など、他国が抑止力の面で優位に立つことを許してしまう。だからこそ、アメリカだけでなく、アメリカと同盟国がAIをリードすることが重要といえる」

「AIは今世紀の重要な抑止力の一つだ。もし私たちがAIでリードしていなければ、敵対する国、ロシアや中国など、他国が抑止力の面で優位に立つことを許してしまう。だからこそ、アメリカだけでなく、アメリカと同盟国がAIをリードすることが重要といえる」

専門家「犠牲を理解する人間の関与が重要」

AIをめぐって軍拡競争の様相となる中、「AI兵器」をめぐる未来はどのようになり、何が懸念されるのか。

アメリカ国防総省でAIの軍事利用についての政策に携わり、この分野の研究の第一人者として知られる新アメリカ安全保障センターのポール・シャーレ氏に話を聞いた。

Q AI兵器の発展どうみる?

ウクライナやガザをはじめとする世界各地の紛争にAIが組み込まれたことで、理論上の懸念が現実のものとなった。この10年間、人々が抱いてきた懸念が、まさに今、結実しつつあるのだと思う。戦場での致命的な意思決定に人間が関与し続けるのか、それともその意思決定を機械に委ねるのか、という懸念だ。AIシステムの性能は進歩を重ねており、AIシステムができることは増えている。今、AIの発展は本当に目覚ましい。

Q「AI兵器」は火薬、核に次ぐ”第3の軍事革命”になるか?

まだ、そこには到達していないが、時間が経てばそうなるかもしれない。今後、数十年の間に、軍隊がAIを採用し、作戦のすべてにAIを統合するようになる。戦争におけるまさに革命的な変化だ。学者の中にはAIによる戦闘のペースがあまりに速く、人間の能力が追いつけなくなり、人間が事実上、機械にコントロールを譲らなければならなくなる時点についての仮説を立てている者もいる。その時、人間はどうやって戦争をコントロールするのだろうか。もし人間が機械に制御を委ね、機械が事実上超人的なスピードで戦っているとしたら、どうやって戦争を終わらせることができるのだろうか。

Q ガザ地区でのイスラエルのAIシステム、どう見る?

Q AI兵器の発展どうみる?

ウクライナやガザをはじめとする世界各地の紛争にAIが組み込まれたことで、理論上の懸念が現実のものとなった。この10年間、人々が抱いてきた懸念が、まさに今、結実しつつあるのだと思う。戦場での致命的な意思決定に人間が関与し続けるのか、それともその意思決定を機械に委ねるのか、という懸念だ。AIシステムの性能は進歩を重ねており、AIシステムができることは増えている。今、AIの発展は本当に目覚ましい。

Q「AI兵器」は火薬、核に次ぐ”第3の軍事革命”になるか?

まだ、そこには到達していないが、時間が経てばそうなるかもしれない。今後、数十年の間に、軍隊がAIを採用し、作戦のすべてにAIを統合するようになる。戦争におけるまさに革命的な変化だ。学者の中にはAIによる戦闘のペースがあまりに速く、人間の能力が追いつけなくなり、人間が事実上、機械にコントロールを譲らなければならなくなる時点についての仮説を立てている者もいる。その時、人間はどうやって戦争をコントロールするのだろうか。もし人間が機械に制御を委ね、機械が事実上超人的なスピードで戦っているとしたら、どうやって戦争を終わらせることができるのだろうか。

Q ガザ地区でのイスラエルのAIシステム、どう見る?

イスラエル軍によるAIの使用方法に関する主な懸念のひとつは、民間人の犠牲に関するものだ。いくつか浮上している疑惑では、イスラエル軍がAIを使用して、潜在的な標的に関する情報を生成するためにデータを集約していることを示唆している。イスラエル軍の元将校や現役の将校の中には、このプロセスに対する人間の監視はごくわずかだったと主張する者もいる。技術的には人間がこれらの攻撃を許可する“輪の中”に入っていたが、人間の関与はかなりざっくりとした最小限のものだったというのだ。戦争における致命的な決定に対する人間の制御を維持する必要性を考えれば、これは確かに懸念すべきことだ。

Q 完全自律の「究極のAI兵器」の懸念点は?

自律型兵器に関する懸念のひとつは、武力行使の決定に人間があまり関与しなくなるということだ。機械が単純に計算を行い、攻撃を許可し、誰もその攻撃の人的コストについて考えることなく実行する。そしてそのことが、長期的にはより多くの殺りくや苦しみ、あるいはより多くの民間人の犠牲を生むことになりかねない。AIがより精密になったとしても、戦争の犠牲を理解するために人間が関与することを確実にする方法が必要だ。

Q 国際社会の規制の現状は?

Q 完全自律の「究極のAI兵器」の懸念点は?

自律型兵器に関する懸念のひとつは、武力行使の決定に人間があまり関与しなくなるということだ。機械が単純に計算を行い、攻撃を許可し、誰もその攻撃の人的コストについて考えることなく実行する。そしてそのことが、長期的にはより多くの殺りくや苦しみ、あるいはより多くの民間人の犠牲を生むことになりかねない。AIがより精密になったとしても、戦争の犠牲を理解するために人間が関与することを確実にする方法が必要だ。

Q 国際社会の規制の現状は?

国連では10年前から各国が自律型兵器について話し合っている。ただ、何をすべきかについての合意は得られていない。30ほどの国々が、自律型兵器を禁止する包括的な条約を結びたいと訴えている。その他の国、特にアメリカとロシアは、自律型兵器を禁止する条約には反対で、戦争法の下での既存のルールで十分だと主張している。そして、その中間に位置し、何らかの規制を求める国もある。しかし、今のところ合意は得られておらず、世界の主要な軍事大国はいずれも自律型兵器の禁止には賛同していない。そのことが何らかの意味のある規制を導入するための障害となっている。

Q 規制できない場合に想定されることは?

何らかの技術的な規制の「ガードレール」がなければ、民間人の犠牲が増えたり、自律型兵器の使用が国家間の不安定化を招いたりする事態が想定される。南シナ海、台湾海峡、東シナ海、黒海などのように国家が互いに活動する地域で、機械が判断を行う世界では、機械が撃つべきでないものを撃ってしまい、国家間の緊張を高めるような事件を引き起こしてしまう事態が起こりうる。そのため、この技術をどのように取り入れるかについて、国家間で何らかのルールやガイドラインを作ることが急務だ。

Q AI兵器で、世界の未来はどう変わる?

どの国もAIの導入に関心を持ち、軍事・非軍事の分野でAIのリーダーとなることを望んでいる。急速な技術革新の中で、自国の軍隊を向上させるためにこれらの技術を活用することが重要となっている。なぜなら、取り残される危険性があるからだ。過去の軍事的な技術革新で、飛行機や戦車のような新技術が戦場に導入されたとき、その革命に乗り遅れた軍隊の代償は深刻なものとなってきた。遅れをとり、時には国家が立ち直れないほどの敗戦を喫することもあった。

Q 規制できない場合に想定されることは?

何らかの技術的な規制の「ガードレール」がなければ、民間人の犠牲が増えたり、自律型兵器の使用が国家間の不安定化を招いたりする事態が想定される。南シナ海、台湾海峡、東シナ海、黒海などのように国家が互いに活動する地域で、機械が判断を行う世界では、機械が撃つべきでないものを撃ってしまい、国家間の緊張を高めるような事件を引き起こしてしまう事態が起こりうる。そのため、この技術をどのように取り入れるかについて、国家間で何らかのルールやガイドラインを作ることが急務だ。

Q AI兵器で、世界の未来はどう変わる?

どの国もAIの導入に関心を持ち、軍事・非軍事の分野でAIのリーダーとなることを望んでいる。急速な技術革新の中で、自国の軍隊を向上させるためにこれらの技術を活用することが重要となっている。なぜなら、取り残される危険性があるからだ。過去の軍事的な技術革新で、飛行機や戦車のような新技術が戦場に導入されたとき、その革命に乗り遅れた軍隊の代償は深刻なものとなってきた。遅れをとり、時には国家が立ち直れないほどの敗戦を喫することもあった。

しかし、法や文明社会のルールや倫理、価値観などの中で、このテクノロジーをどのように使うのか。そこでは人間性を低下させないようにすることが重要だ。機械は「共感」という感情がない。戦争が人間にもたらす犠牲を理解することもできない。だからこそ、人間が戦争における人命に関わる意思決定に関与し続けることが重要なのだ。もし人間の命というコストを考慮することがないような事態になれば、私たちの行く手には暗い未来が待っているかもしれない。

(5月8日 クローズアップ現代で放送)

(5月8日 クローズアップ現代で放送)

国際部記者

山下 涼太

2016年入局 沖縄局を経て2021年から国際部

大学時代にワシントンDCに留学 アメリカ政治や安全保障を取材

山下 涼太

2016年入局 沖縄局を経て2021年から国際部

大学時代にワシントンDCに留学 アメリカ政治や安全保障を取材